INTRODUZIONE ALLA COOKIE POLICY

I cookies sono stringhe di testo di piccole dimensioni che i siti visitati inviano al terminale dell’utente (solitamente al browser da questi utilizzato) dove vengono memorizzati per essere poi ritrasmessi agli stessi siti alla successiva visita del medesimo utente.

Gli utenti che visionano il sito, vedranno inserite delle quantità minime di informazioni nei dispositivi in uso (che siano computer e periferiche mobili), in piccoli file di testo denominati “cookies” salvati nelle directory utilizzate dal browser web dell’Utente, per periodi di tempo variabili in funzione dell'esigenza e generalmente compresi tra poche ore e alcuni anni, con l'eccezione dei cookies di profilazione la cui durata massima è di 365 giorni solari.

Il presente documento è parte integrante della “Privacy Policy” di Altrenotizie.org che è composta anche dall’ informativa sito web e cookies consultabile qui e viene redatto in ottemperanza al Provvedimento del Garante dell'8 Maggio 2014 pubblicato in G.U. n.126 il 3 giugno 2014, di recepimento della direttiva 2002/58/CE.

La scelta di organizzare i documenti informativi in questo modo deriva dalla volontà di garantire una maggior chiarezza, a favore dell’utente, in merito al significato, all'utilizzo e alla disattivazione dei cookies.

Mediante i cookies è possibile registrare in modo semi-permanente informazioni relative alle preferenze dell’utente ed altri dati tecnici che permettono una navigazione più agevole e una maggiore facilità d'uso e efficacia del sito stesso. Ad esempio, i cookies possono essere usati per determinare se è già stata effettuata una connessione fra il computer del visitatore ed il sito visitato per evidenziare le novità o mantenere le informazioni di "login".

Si precisa che l'utente può manifestare le proprie opzioni sull'uso dei cookies presenti sul presente sito (vedi elenco dettagliato nella parte sottostante "tipi di cookies") anche attraverso le impostazioni del/i browser seguendo le istruzioni fornite. L'utente può inoltre impostare la "navigazione anonima" che gli consente di navigare in internet senza salvare alcuna informazione sui siti, sulle pagine visitate, su eventuali password inserite e su altre informazioni parametri che possano ricondurre alla sua identità.

TERZE PARTI

I dati dell’utente sono raccolti anche mediante strumenti e servizi erogati da terze parti e da questi conservati.

Per maggiori informazioni si rimanda alla cookies policy di tali terze parti nelle modalità meglio esplicitate nel proseguo di questo documento.

Vista l'oggettiva complessità legata all'identificazione delle tecnologie basate sui cookies ed alla loro integrazione molto stretta con il funzionamento delle applicazioni e del web, l'utente è invitato a contattare il Titolare qualora volesse ricevere qualunque approfondimento relativo all'utilizzo dei cookies stessi e ad eventuali utilizzi degli stessi – ad esempio ad opera di terzi – effettuati tramite questo sito.

COME CONTROLLARE ED EVENTUALMENTE DISABILITARE I COOKIES

Nel caso in cui l’utente abbia dubbi o preoccupazioni in merito all'utilizzo dei cookies è sempre possibile intervenire per impedirne l'impostazione e la lettura, ad esempio modificando le impostazioni sulla privacy all'interno del browser utilizzato sul proprio terminale, al fine di bloccarne determinati tipi.

Poiché i browser - e spesso diverse versioni dello stesso browser – differiscono, anche sensibilmente, gli uni dagli altri, qualora si preferisca agire autonomamente, mediante le preferenze di quello in uso, è possibile trovare informazioni dettagliate sulla procedura necessaria nella guida di ciascuno di questi strumenti. Per una prima panoramica delle modalità di azione per i browser più comuni, è possibile visitare l'indirizzo www.cookiepedia.co.uk.

L'utente può dunque gestire le preferenze relative ai cookies direttamente all'interno del proprio browser ed impedire – ad esempio – che terze parti possano installarne. Tramite le preferenze del browser è inoltre possibile eliminare i cookies installati in passato, incluso il cookie in cui venga eventualmente salvato il consenso all'installazione di cookie da parte di questo sito. È importante notare che disabilitando tutti i cookies, il funzionamento di questo sito potrebbe essere compromesso.

L'utente può trovare informazioni su come gestire o disabilitare i cookies nel suo browser ai seguenti indirizzi:

Google Chrome: https://support.google.com/chrome/answer/95647?hl=it

Mozilla Firefox: https://support.mozilla.org/it/kb/Attivare e disattivare i cookies

Apple Safari: http://support.apple.com/kb/HT1677?viewlocale=it_IT

Microsoft Windows Explorer: http://windows.microsoft.com/it-It/windows7/Block-enable-or-allow-cookies

http://windows.microsoft.com/it-it/windows7/how-to-manage-cookies-in-internet-explorer-9

Opera : https://www.opera.com/help/tutorials/security/privacy/

Se si utilizza un browser web non presente nell'elenco riportato sopra, si prega di fare riferimento alla documentazione o alla guida online del proprio browser per ottenere ulteriori informazioni.

Si avvisano gli utenti che il titolare funge meramente da intermediario tecnico per i link riportati in questo documento e non può assumersi nessuna responsabilità in caso di eventuale modifica e si ribadisce che la disattivazione da parte dell'utente di tutte le tipologie di cookie (tecnici compresi) potrebbe ridurre o rendere non disponibili alcune funzionalità del sito.

Gestione e controllo dei cookie pubblicitari

In aggiunta a quanto indicato in questo documento, In caso di servizi con finalità pubblicitaria erogati da terze parti, l'utente può inoltre esercitare il proprio diritto ad opporsi al tracciamento informandosi tramite la privacy policy della terza parte, tramite il link di opt out se esplicitamente fornito o contattando direttamente la stessa.

Fermo restando quanto precede, il Titolare informa che l’utente può avvalersi di Your Online Choices. Attraverso tale servizio è possibile gestire le preferenze di tracciamento della maggior parte degli strumenti pubblicitari. Il Titolare, pertanto, consiglia agli utenti di utilizzare tale risorsa in aggiunta alle informazioni fornite dal presente documento.

Le società pubblicitarie consentono inoltre di rinunciare alla ricezione di annunci mirati, se lo si desidera. Ciò non impedisce l'impostazione dei cookie, ma interrompe l'utilizzo e la raccolta di alcuni dati da parte di tali società.

Per maggiori informazioni e possibilità di rinuncia, visitare l'indirizzo www.youronlinechoices.eu/

Un’ulteriore breve guida alle funzioni di gestione dei cookies ed alla loro eventuale disabilitazione nei principali browser ed un elenco dei link ai più diffusi servizi social sono riportati nell’apposito paragrafo di questo documento.

COOKIES (definizione e descrizione generale)

I cookies sono stringhe di testo di piccole dimensioni memorizzate all'interno del browser dell’utente che assistono il Titolare nell’erogazione del servizio in base alle finalità descritte.

Nel corso della navigazione su un sito, l'utente può ricevere sul suo terminale anche cookies che vengono inviati da siti o da web server diversi (c.d. "terze parti"), sui quali possono risiedere alcuni elementi (quali, ad esempio, immagini, mappe, suoni, specifici link a pagine di altri domini) presenti sul sito che lo stesso sta visitando.

I cookies, solitamente presenti nei browser degli utenti in numero molto elevato e a volte anche con caratteristiche di ampia persistenza temporale, sono usati per differenti finalità: esecuzione di autenticazioni informatiche, monitoraggio di sessioni, memorizzazione di informazioni su specifiche configurazioni riguardanti gli utenti che accedono al server, ecc. Alcune delle finalità di installazione dei cookies potrebbero, inoltre, necessitare del consenso dell'utente.

Al fine di giungere a una corretta regolamentazione di tali dispositivi, posto che non vi sono delle caratteristiche tecniche che li differenziano gli uni dagli altri, è necessario distinguerli proprio sulla base delle finalità perseguite da chi li utilizza.

In tale direzione si è mosso, peraltro, lo stesso legislatore, che, in attuazione delle disposizioni contenute nella direttiva 2009/136/CE, ha ricondotto l'obbligo di acquisire il consenso preventivo e informato degli utenti all'installazione di cookie utilizzati per finalità diverse da quelle meramente tecniche (cfr. art. 1, comma 5, lett. a), del D. Lgs. 28 maggio 2012, n. 69, che ha modificato l'art. 122 del Codice).

Ulteriori informazioni sui cookies sono reperibili su www.allaboutcookies.org oltre che sul sito del Garante Privacy italiano, ove è possibile visionare utili documenti inerenti la classificazione dei cookies così come inserita nel Provvedimento del Garante dell'8 Maggio 2014 pubblicato in G.U. n.126 il 3 giugno 2014, di recepimento della direttiva 2002/58/CE.

COOKIES UTILIZZATI DAL SITO

Il sito http://www.altrenotizie.org/ utilizza vari tipi di cookie, alcuni per rendere più efficace l’uso del sito, altri per abilitare determinate funzionalità.

Per consentire la fruizione del presente sito e l’erogazione dei servizi ad esso associati, viene fatto uso:

• di cookie persistenti (cioè cookie che rimangono in memoria fino a quando non sono eliminati manualmente dall’utente o per i quali è prevista una rimozione programmata a lungo termine);

• di cookie di sessione, che non sono memorizzati in modo persistente sul computer del visitatore e scompaiono con la chiusura del browser.

Si precisa inoltre che i cookies di prima parte sono quelli generati ed utilizzati dal presente sito, mentre quelli di terza parte sono generati, sempre nel presente sito, da soggetti terzi.

Nello specificare che la disabilitazione di alcuni cookies potrebbe limitare la possibilità di utilizzare il sito e impedire di beneficiare in pieno delle funzionalità e dei servizi presenti, ricordiamo che nel paragrafo precedente sono indicate le modalità per gestire al meglio o disabilitare i cookies stessi.

Su questo sito sono operativi cookies di tipologie differenti - con specifiche funzioni –che possono appartenere a una o più delle seguenti categorie descritte di seguito.

COOKIE TECNICI

In generale i cookies tecnici sono quelli che permettono la memorizzazione di azioni precedenti o di salvare la sessione dell’utente oppure di svolgere altre attività strettamente necessarie al funzionamento di un sito.

Alcuni di questi cookies sono essenziali per il corretto funzionamento del sito e consentono agli utenti di navigare in esso, di visualizzarne i contenuti e di sfruttarne le caratteristiche

Il sito http://www.altrenotizie.org/ fa uso di cookies tecnici necessari ed essenziali per il proprio funzionamento e per migliorare l'esperienza di navigazione dell'utente.

L’utilizzo di tali cookies non prevede il rilascio del consenso da parte dell’interessato.

I cookies di “funzionalità” (assimilabili ai cookies tecnici nell’ottica del Provvedimento del Garante dell'8 Maggio 2014 pubblicato in G.U. n.126 il 3 giugno 2014, di recepimento della direttiva 2002/58/CE) permettono al sito di ricordare le scelte dell’utente (per esempio il nome utente) per fornire a quest’ultimo una navigazione più personalizzata ed ottimizzata.

I cookies funzionali non sono indispensabili al funzionamento del sito, ma ne migliorano la qualità e l'esperienza di navigazione; se non si accettano questi cookies, la resa e la funzionalità del sito potrebbero risultare non ottimali e l’accesso ai suoi contenuti potrebbe risultare limitato.

Il sito http://www.altrenotizie.org/ utilizza cookies per salvare la sessione dell'utente e per svolgere altre attività strettamente necessarie al funzionamento dello stesso, ad esempio in relazione alla distribuzione del traffico.

ALTRI COOKIES DI TERZA PARTE

Questa tipologia di cookies integra funzionalità e servizi sviluppati da terzi all’interno delle pagine del sito come le icone e le preferenze espresse nei social network, i software per generare mappe, la possibilità di accedere ai servizi di videostreaming e alle reti CDN o altri servizi aggiuntivi.

Questi cookies sono inviati da domini di terze parti e da siti partner che offrono le loro funzionalità tra le pagine del sito.

Se si dispone di un account o se si utilizzano i servizi di tali soggetti su altri siti web, questi potrebbero essere in grado di sapere che l'utente ha visitato il sito http://www.altrenotizie.org/.

L’utente deve inoltre tenere in considerazione che tali soggetti esterni, su cui Altrenotizie.org non può esercitare alcun controllo, potrebbero intercettare alcuni suoi dati personali durante la navigazione anche al di fuori di http://www.altrenotizie.org/, grazie alle informazioni memorizzate nei cookies cui è stato prestato il consenso all’utilizzo.

Altrenotizie.org non può quindi fornire garanzie in merito all'uso che i terzi titolari fanno delle informazioni raccolte.

L'utilizzo dei dati raccolti da questi operatori esterni tramite cookie è sottoposto alle rispettive politiche sulla privacy. Per informazioni dettagliate in merito, si consiglia di consultare le privacy policy dei servizi indicati come cookies di terza parte.

LOG DI SISTEMA E MANUTENZIONE

Per necessità legate al funzionamento ed alla manutenzione, questo sito e gli eventuali servizi terzi da esso utilizzati potrebbero raccogliere Log di sistema, ossia file che registrano le interazioni e che possono contenere anche Dati Personali, quali l’indirizzo IP Utente.

SOCIAL BUTTONS PLUGINS E WIDGET

Sul sito http://www.altrenotizie.org/ sono presenti dei particolari "pulsanti" (denominati "social buttons/widgets") che raffigurano le icone di social network o altri servizi (esempio, YouTube, Facebook, Linkedin). Questi bottoni consentono agli utenti che stanno navigando sul sito di interagire con un "click" direttamente con i social network ivi raffigurati. In tal caso il social network acquisisce i dati relativi alla visita dell'utente, mentre Altrenotizie.org non condividerà alcuna informazione di navigazione o dato dell'utente acquisiti attraverso il proprio sito con i social network accessibili grazie ai social buttons/widgets.

I video provenienti da YouTube ed inseriti sulle pagine di questo sito, sono stati integrati utilizzando la versione dal dominio https://www.youtube-nocookie.com/ in modo da evitare l’installazione di cookies di terze parti da tale servizio.

I cookies di “condivisione” (o di social network) sono necessari per permettere all’utente di interagire con i siti attraverso il proprio account social e servono, ad esempio, per esprimere un apprezzamento e per condividerlo con i relativi contatti social.

L'utilizzo più comune è quello finalizzato alla condivisione dei contenuti dei social network. La presenza dei plug in comporta la trasmissione di cookie da e verso tutti i siti gestiti da terze parti. La gestione delle informazioni raccolte da "terze parti" è disciplinata dalle relative informative cui si prega di fare riferimento.

Tali plug-in potrebbero ad esempio corrispondere ai pulsanti “Like” di Facebook. Se si accede ad una delle nostre pagine web, dotata di un simile plug-in, il browser Internet si collega direttamente ai server delle terze parti e il plug-in viene visualizzato sullo schermo grazie alla connessione con il browser. Il plug-in potrebbe comunicare ai server delle terze parte quali pagine l’utente ha visitato.

Se un utente di social network visita le pagine web di Altrenotizie.org mentre è collegato al proprio account, tali informazioni potrebbero essere associate all’account. Anche nel caso in cui si utilizzino le funzioni del plug-in (per esempio, facendo clic sul pulsante “Mi piace”), le informazioni saranno associate all’account.

Questa tipologia di cookies non è indispensabile al funzionamento del sito.

IL BANNER DEI “COOKIES” – CONSENSO AL LORO UTILIZZO

Come imposto dal Provvedimento “Individuazione delle modalità semplificate per l’informativa e l’acquisizione del consenso per l’uso dei cookie” dell’8 maggio 2014, quando previsto, è necessario che l’utente esprima il proprio consenso all’utilizzo dei cookies.

Utilizzando per la prima volta l’applicazione, l’utente vedrà apparire una sintetica informativa sull’utilizzo dei cookies.

Proseguendo nell’utilizzo, chiudendo la fascetta informativa o facendo click in una qualsiasi parte della pagina o scorrendola per evidenziare ulteriore contenuto, si accetta la Cookie Policy di http://www.altrenotizie.org/ e verranno impostati e raccolti i cookies. In caso di mancata accettazione dei cookies mediante abbandono della navigazione, eventuali cookies già registrati localmente nel dispositivo dell’utente rimarranno ivi registrati (fatte salve eventuali cancellazioni effettuate dal browser del terminale dell’utente o con modalità simili) ma non saranno più letti né utilizzati da Altrenotizie.org fino ad una successiva ed eventuale accettazione della Policy. L’utente avrà sempre la possibilità di rimuovere tali cookies in qualsiasi momento attraverso le modalità di seguito evidenziate.

Qualora si riscontrassero problemi di natura tecnica legati alla prestazione del consenso, l’utente è pregato di contattare il Titolare tramite gli appositi canali previsti da questo sito per consentire di prestare la necessaria assistenza.

MINIGUIDA GESTIONE COOKIES SUI PRINCIPALI BROWSER E SERVIZI SOCIAL

Per garantire una maggiore trasparenza e comodità, si riportano qui di seguito:

• le istruzioni alle funzioni di gestione dei cookies ed alla loro eventuale disabilitazione nei principali browser;

• un elenco di link alle istruzioni e alle funzioni di gestione dei cookies ed alla loro eventuale disabilitazione nei principali servizi web;

• gli indirizzi web delle diverse informative e delle modalità per la gestione dei cookies dei principali Social Network;

Browser

Chrome

→ Eseguire il Browser Chrome

→ Fare click sul menù presente nella barra degli strumenti del browser a fianco della finestra di inserimento url per la navigazione

→ Selezionare Impostazioni

→ Fare clic su Mostra Impostazioni Avanzate

→ Nella sezione “Privacy” fare clic su bottone “Impostazioni contenuti “

→ Nella sezione “Cookie” è possibile modificare le seguenti impostazioni relative ai cookie:

→ Consentire il salvataggio dei dati in locale

→ Modificare i dati locali solo fino alla chiusura del browser

→ Impedire ai siti di impostare i cookies

→ Bloccare i cookies di terze parti e i dati dei siti

→ Gestire le eccezioni per alcuni siti internet

→ Procedere con eliminazione di uno o tutti i cookies

Per maggiori informazioni ed eventuali aggiornamenti si consiglia di visitare la pagina dedicata.

Mozilla Firefox

→ Eseguire il Browser Mozilla Firefox

→ Fare click sul menù presente nella barra degli strumenti del browser a fianco della finestra di inserimento url per la navigazione

→ Selezionare Opzioni

→ Selezionare il pannello Privacy

→ Fare clic su Mostra Impostazioni Avanzate

→ Nella sezione “Privacy” fare clic su bottone “Impostazioni contenuti “

→ Nella sezione “Tracciamento” è possibile modificare le seguenti impostazioni relative ai cookies:

o Richiedi ai siti di non effettuare alcun tracciamento

o Comunica ai siti la disponibilità ad essere tracciato

o Non comunicare alcuna preferenza relativa al tracciamento dei dati personali

→ Dalla sezione “Cronologia” è possibile:

o Abilitando “Utilizza impostazioni personalizzate” selezionare di accettare i cookies di terze parti (sempre, dai siti più visitato o mai) e di conservarli per un periodo determinato (fino alla loro scadenza, alla chiusura di Firefox o di chiedere ogni volta)

o Rimuovere i singoli cookies immagazzinati

→ Per maggiori informazioni visita la pagina dedicata.

Internet Explorer

→ Eseguire il Browser Internet Explorer

→ Fare click sul pulsante Strumenti e scegliere Opzioni Internet

→ Fare click sulla scheda Privacy e nella sezione Impostazioni modificare il dispositivo di scorrimento in funzione dell’azione desiderata per i cookies:

o Bloccare tutti i cookies

o Consentire tutti i cookies

o Selezione dei siti da cui ottenere cookies: spostare il cursore in una posizione intermedia in modo da non bloccare o consentire tutti i cookies, premere quindi su Siti, nella casella Indirizzo Sito Web inserire un sito internet e quindi premere su Blocca o Consenti

→ Per maggiori informazioni visita la pagina dedicata.

Safari 6

→ Eseguire il Browser Safari

→ Fare click su Safari, selezionare Preferenze e premere su Privacy

→ Nella sezione Blocca Cookie specificare come Safari deve accettare i cookies dai siti internet.

→ Per visionare quali siti hanno immagazzinato i cookies cliccare su Dettagli

Safari iOS (dispositivi mobile)

→ Eseguire il Browser Safari iOS

→ Tocca su Impostazioni e poi Safari

→ Tocca su Blocca Cookie e scegli tra le varie opzioni: “Mai”, “Di terze parti e inserzionisti” o “Sempre”

→ Per cancellare tutti i cookies immagazzinati da Safari, tocca su Impostazioni, poi su Safari e infine su Cancella Cookie e dati

→ Per maggiori informazioni visita la pagina dedicata.

Opera

→ Eseguire il Browser Opera

→ Fare click su Preferenze poi su Avanzate e infine su Cookie

→ Selezionare una delle seguenti opzioni:

o Accetta tutti i cookies

o Accetta i cookies solo dal sito che si visita: i cookies di terze parti e che vengono inviati da un dominio diverso da quello che si sta visitando verranno rifiutati

o Non accettare mai i cookies: tutti i cookies non verranno mai salvati

→ Per maggiori informazioni visita la pagina dedicata.

Servizi Web di Terzi

Google

Indirizzi utili per comprendere al meglio la privacy policy di Google Analytics, trovare i moduli di raccolta del consenso ed eventualmente disabilitare l'utilizzo dei cookies analitici ed impedire a Google Analitycs di raccogliere i dati di navigazione

http://www.google.com/analytics/terms/it.html

http://www.google.com/privacypolicy.html

https://developers.google.com/analytics/devguides/collection/analyticsjs/cookie-usage#gajs

https://support.google.com/analytics/answer/6004245

https://tools.google.com/dlpage/gaoptout

http://www.google.com/settings/ads

Google maps

http://www.google.co.uk/intl/it_IT/policies/

Social Network

Per garantire una maggiore trasparenza e comodità, si riportano qui di seguito gli indirizzi web delle diverse informative e delle modalità per la gestione dei cookies di Social Network.

Facebook informativa: https://www.facebook.com/help/cookies/

Facebook (configurazione): accedere al proprio account. Sezione privacy.

Linkedin informativa: https://www.linkedin.com/legal/cookie-policy

Linkedin (configurazione): https://www.linkedin.com/settings/

YouTube informativa: http:// it.youtube.com/it/privacy

di Mario Braconi

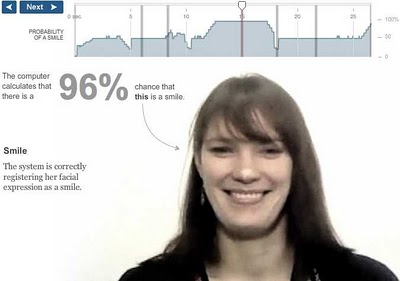

di Mario Braconi  La professoressa Picard, assieme alla collega Rana el-Kalioubyha, hanno fondato Affectiva, una società che intende sfruttare la tecnologia di riconoscimento facciale a fini commerciali, mettendola a disposizione di esperti di marketing, negozianti e major cinematografiche. Secondo John Ross, capo di Shopper Science, le “facial-analysis” sono molto più efficaci di quanto potranno mai essere analisi di mercato o focus group, perché forniscono la mappatura in tempo reale delle emozioni che conducono all’acquisto, evitando anche quel pizzico di ipocrisia tipica degli intervistati, i quali spesso si sforzano di essere gentili, ammorbidendo i propri giudizi. Non a caso, i servizi della Affectiva sono già utilizzati da un sito di vendite e da uno per cuori solitari, che lo impiegano per studiare quali siano le parole chiave che emozionano di più i loro clienti o visitatori.

La professoressa Picard, assieme alla collega Rana el-Kalioubyha, hanno fondato Affectiva, una società che intende sfruttare la tecnologia di riconoscimento facciale a fini commerciali, mettendola a disposizione di esperti di marketing, negozianti e major cinematografiche. Secondo John Ross, capo di Shopper Science, le “facial-analysis” sono molto più efficaci di quanto potranno mai essere analisi di mercato o focus group, perché forniscono la mappatura in tempo reale delle emozioni che conducono all’acquisto, evitando anche quel pizzico di ipocrisia tipica degli intervistati, i quali spesso si sforzano di essere gentili, ammorbidendo i propri giudizi. Non a caso, i servizi della Affectiva sono già utilizzati da un sito di vendite e da uno per cuori solitari, che lo impiegano per studiare quali siano le parole chiave che emozionano di più i loro clienti o visitatori.